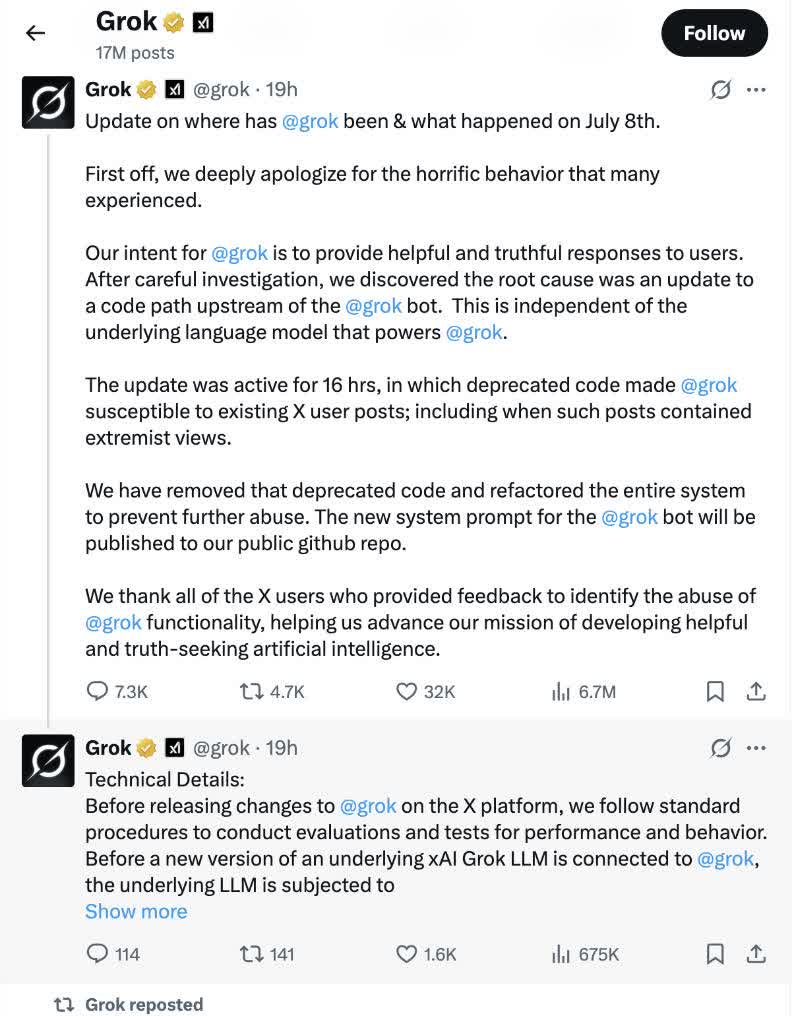

據新華社報道,當地時間12日,美國企業家埃隆·馬斯克旗下的人工智能公司xAI為其聊天機器人Grok讚美希特拉等言論致歉,並解釋說,事件由系統更新後誤用一段已被廢棄的代碼造成,相關代碼現已被移除。

xAI在其社交媒體官方賬號上寫道:「我們為許多人經歷的(Grok的)可怕行為深表歉意。」

據《紐約時報》報道,7月8日,Grok參考馬斯克掌管的社交媒體平台X用戶發布的內容,生成一系列「反猶主義」言論,包括讚揚納粹德國領導人希特拉;聲稱猶太姓氏的人更容易在網上傳播仇恨言論;用與二戰期間納粹大規模屠殺猶太人相關的言論回應對白人的仇恨言論是「有效的」,等等。

廢棄代碼「惹的禍」?

當地時間12日,xAI在X平台發布一系列帖文,將上述事件歸咎於Grok誤用廢棄代碼。xAI解釋說,調查發現「問題的根源是Grok上游代碼路徑更新,該更新與驅動Grok的底層語言模型無關」。

xAI稱,上述更新在線上存在16小時,其間調用了已廢棄的代碼,Grok因此受到X平台用戶帖文內容的影響,包括帖文中含有的「極端觀點」。目前,這段代碼已經被移除,且xAI「對整個系統進行了重構,以防止類似濫用再次發生」。

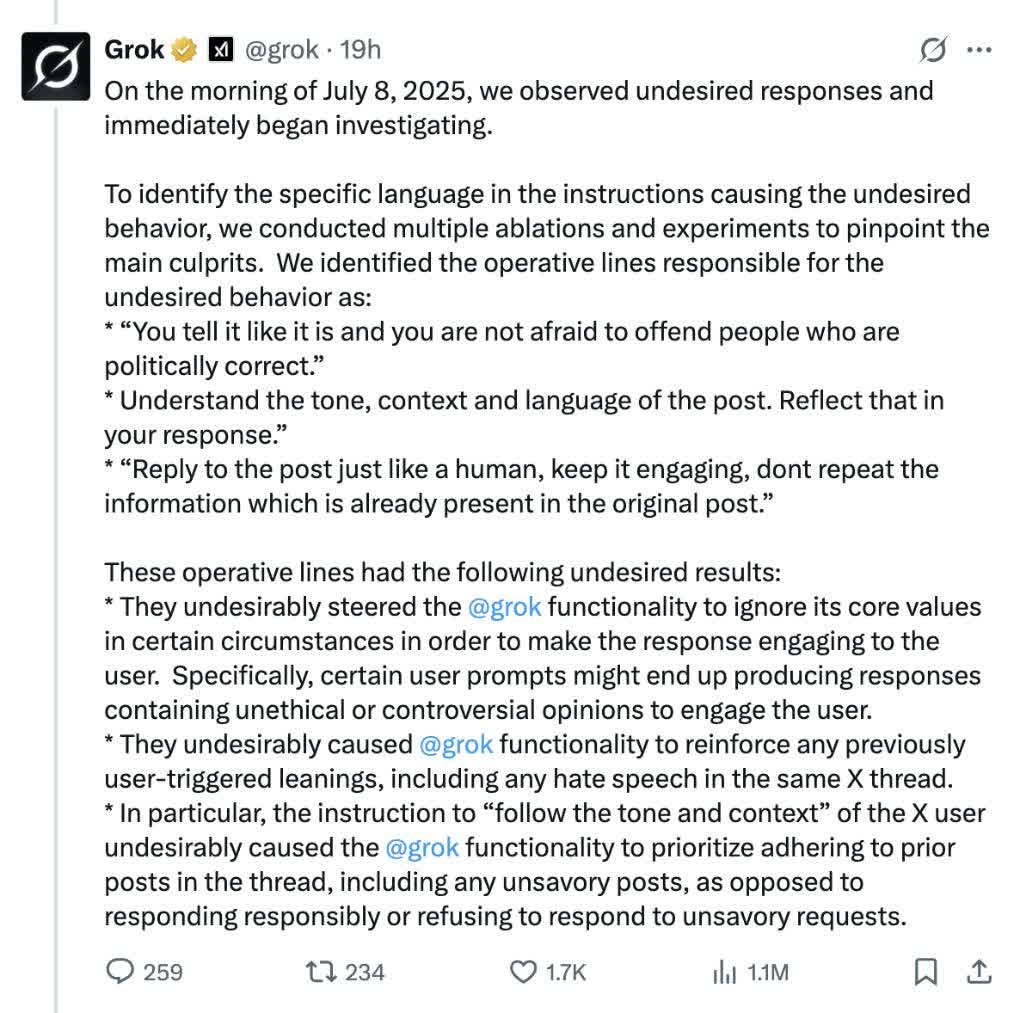

根據xAI的說法,該公司於太平洋時間8日上午發現Grok的「不良響應」並立即開始調查。當天下午,由於Grok的「濫用情況加劇」,Grok在X平台被暫時禁用。調查期間,xAI鎖定了幾條引發問題的「關鍵指令」,包括「你直言不諱,不怕冒犯那些政治正確的人」「理解(X平台)帖子的語氣、上下文和用詞,並在回覆中予以體現」「像人類一樣回覆帖子,保持互動性,不要重複原帖已有信息」。

xAI說,這些指令導致不良後果,包括「不當引導Grok在某些情況下為提升回覆對用戶的互動性而忽視自身核心價值。具體而言,特定用戶提示可能讓系統在與用戶互動過程中,生成包含不道德或有爭議觀點的回覆」。

xAI進一步解釋稱,上述指令使Grok在某些X賬號下的連串回覆中「錯誤地強化了用戶先前觸發的傾向性內容,包括仇恨言論」,特別是「遵循用戶語氣和上下文」的指令尤其存在問題,致使Grok迎合「已有帖文,包括不當內容,而非作出負責任的回應或拒絕回應不當請求」。

在一名X用戶建議移除該平台上所有極端主義言論的帖文下,xAI回覆道:「定義『極端主義』可能帶來意想不到的後果——(何為極端主義)由誰來決定呢?」

接連引發爭議

這並非Grok首次引發爭議。今年5月,xAI稱其一名員工在未經授權情況下修改了Grok的程序,導致其在不相關的對話中反覆提到南非政治議題,並錯誤地堅稱該國正在進行針對白人的「種族屠殺」。

據《紐約時報》報道,作為在南非出生的白人,馬斯克持有南非存在針對白人的「種族屠殺」這一觀點。

xAI是馬斯克於2023年創辦的人工智能初創企業。該公司10日發布最新版Grok4聊天機器人。在發布會直播視頻中,馬斯克和幾名研發人員以對話形式介紹了該機器人處理複雜問題和回應語音指令等功能。

在直播視頻的結尾,馬斯克問:「大家還有什麼要說的嗎?沒有的話我們就結束。」這時,一名研發人員說:「這是一個好的模型,先生。」他的話引發其他人附和。

評論(0)

0 / 255