開創機器學習研究 深化運算能力理解

香港文匯報訊 人工智能(AI)技術近年發展得如火如荼,訓練AI模型的機械學習,需採用名為「人工神經網絡」的結構,令無法思考的計算機,模仿人腦的記憶、聯想和學習等功能。今屆諾貝爾物理學獎授予美國普林斯頓大學教授霍普菲爾德,以及加拿大多倫多大學教授辛頓,表彰其在人工神經網絡的創建,為現今機器學習乃至演算法、生成式AI奠定基礎。

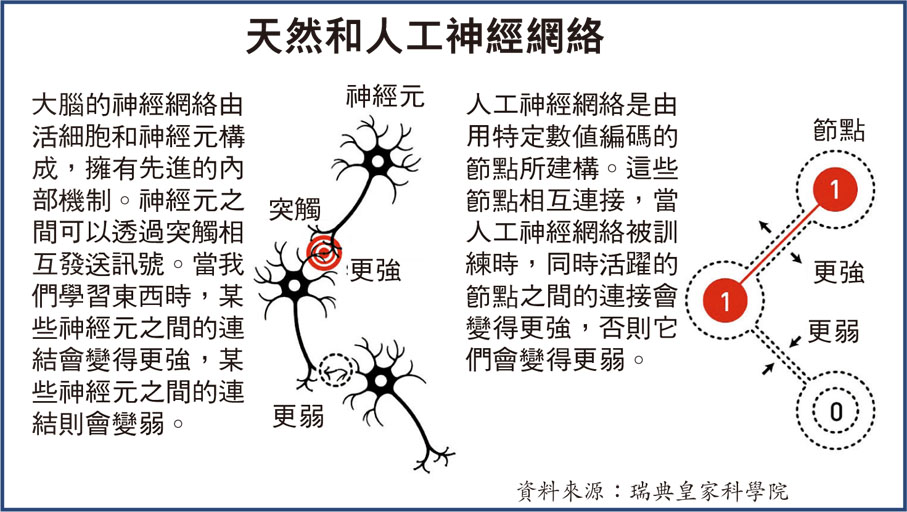

人們一直希望計算機像人腦一樣工作。1940年代起,科學家利用計算機的網絡結構,模擬建構人工神經網絡,用不同數值節點模仿大腦神經元。科學家假設大腦處於學習狀態、神經元協同工作時,會加強彼此之間連接,再將其代入人工神經網絡,模仿調整節點之間連接強度。

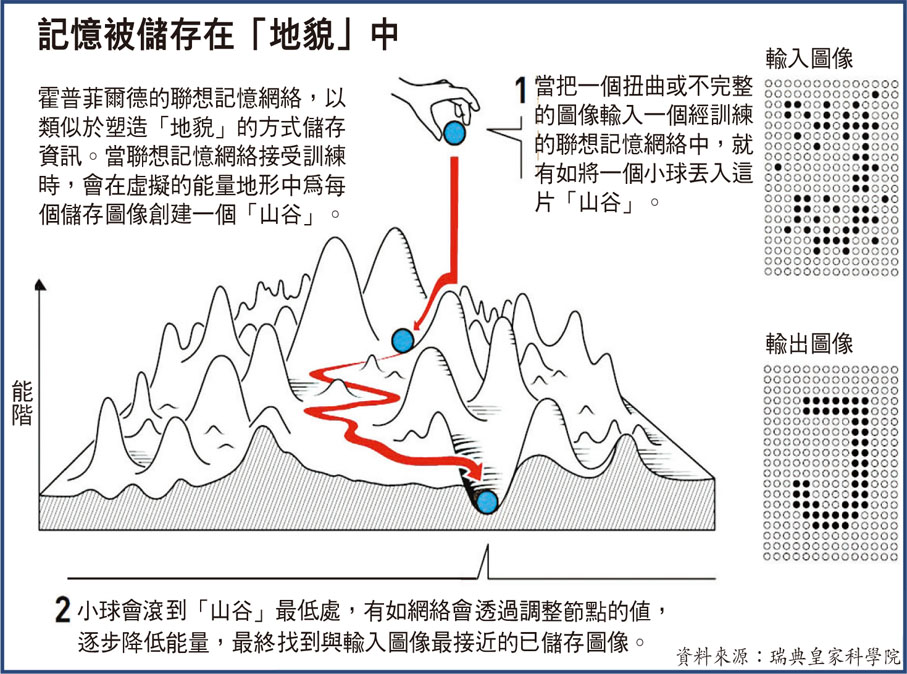

當人們記憶一個新單詞時,可以從與之結構或內容相近的單詞入手。那麼想讓計算機記住一個新單詞,能否也利用這種「聯想」方法呢?這正是霍普菲爾德於1982年發現、如今以其姓氏命名的「霍普菲爾德聯想記憶網絡」,向計算機輸入相同資料的殘缺版本後,計算機便可聯想、拼湊、乃至最後「重建」呈現完整的資料。

透過能量狀態儲存數據

霍普菲爾德從物理學中的電子自旋概念獲得靈感,提出了一種基於遞迴神經網絡的聯想記憶模型,被稱為霍普菲爾德網絡。這網絡的每個節點儲存一個獨立數值,可以是0或1。網絡透過調整節點之間連接的強度來記憶圖像。每向其輸入一個新內容,它會依照能量公式檢查節點,確認是否要更改數值。經過反覆訓練、計算機無法再作改進,即是「聯想」出了結果。如今人們可以用計算機復原模糊的圖像、補充部分缺失的數據、填補有殘頁的書籍,恢復有噪聲的錄音,都是建立在霍普菲爾德網絡的基礎上。

機器學習的另一大挑戰,是令其模仿人腦「歸類」訊息,辛頓在該領域的研究,利用了統計物理學原理,以19世紀物理學家玻爾茲曼等人提出的最大熵原理為基礎,將微觀物理狀態與宏觀物理量統計規律結合。辛頓在霍普菲爾德網絡基礎上,於1985年推出以玻爾茲曼命名的「玻爾茲曼機」。

識別熟悉特徵反覆歸類

玻爾茲曼機可被視作一種人工神經網絡,解決複雜的組合優化問題。機械最終會進入一種狀態,即使改變節點模式,也不會變更神經網絡整體屬性。經訓練的玻爾茲曼機,可以總結所有資料的相似點,識別出它從未見過的訊息中,是否有這些熟悉特徵。就像人們第一次見到朋友的幾名兄弟姊妹,即可通過他們相似的面部特徵,確認他們的親屬關係一樣。

兩名科學家的貢獻,為2010年代興起的機器學習革命奠定基礎。霍普菲爾德1982年推出聯想記憶網絡時,當時的計算機只能追蹤30個節點不到500個參數,如今一個AI系統使用的大型語言模型,可包含超過一萬億個參數,這些掌握理論知識、擁有技術助力的AI系統,逐漸變得更加「聰明」。

諾貝爾獎委員會指出,霍普菲爾德和辛頓利用物理學,為機器學習提供了工具,物理學自身發展,也在從人工神經網絡中受益。兩名獲獎者將平分1,100萬瑞典克朗(約827萬港元)獎金。

獲獎者簡介

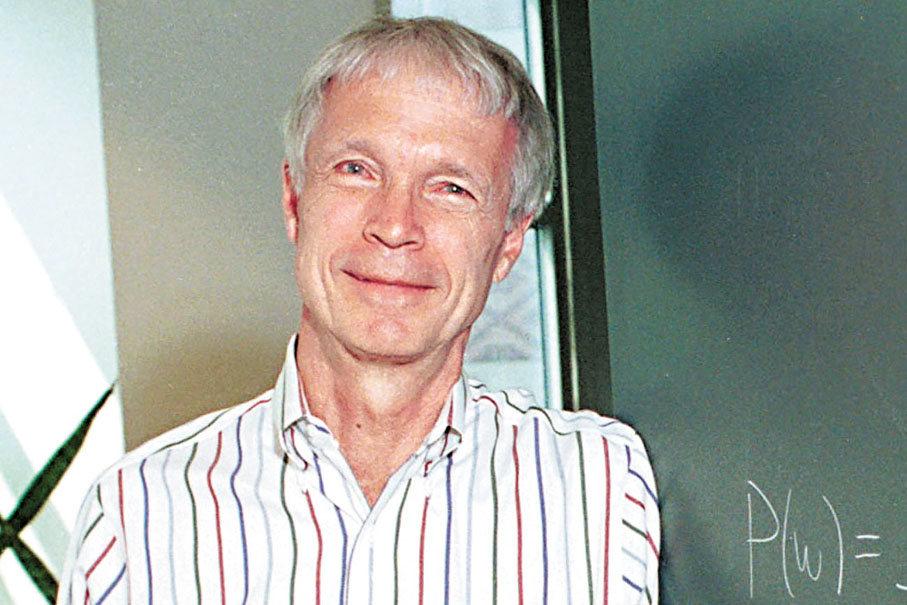

霍普菲爾德(John J. Hopfield)

●出生日期及地點:1933年7月15日(91歲),美國伊利諾伊州芝加哥

●任職機構:美國新澤西州普林斯頓大學

●獲獎原因:提出一種基於遞迴神經網絡的聯想記憶數學模型,被稱為霍普菲爾德網絡。

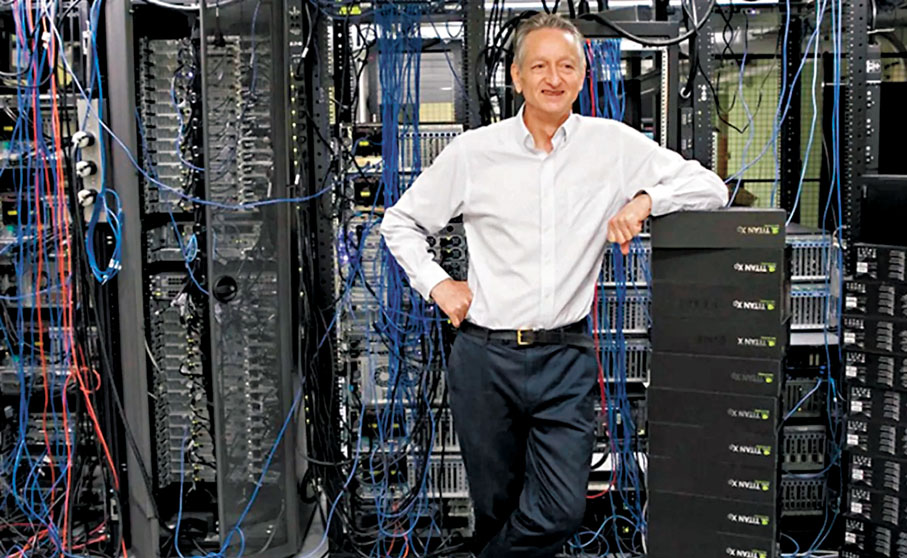

辛頓(Geoffrey E. Hinton)

●出生日期及地點:1947年12月6日(76歲),英國倫敦

●任職機構:加拿大多倫多大學

●獲獎原因:以霍普菲爾德網絡為基礎,結合統計物理學的概念開發「玻爾茲曼機」。

評論