(香港文匯網記者 郭若溪)如何把一張老照片修復得又快又好?長期以來,圖像復原領域一直面臨一個難題:要麼追求質量卻耗時漫長,要麼追求速度卻犧牲細節。7月28日,中國科學院深圳先進技術研究院數字所董超研究員團隊發布了一項名為HYPIR的圖像復原大模型,不僅比現有的圖像復原技術快數十倍,更在高清分辨率、文字保真、理解能力、用戶控制靈活性等方面展現出了優異性能,為圖像復原技術的實際應用提供了更高效的解決方案,為文化傳承與保護、影視修復等領域帶來新的可能性。

「以往圖像復原方法中往往包括擴散模型蒸餾、ControlNet適配器或者多步推理過程。而HYPIR不需要依賴這些步驟,使用方法更加簡單。在訓練和推理速度上較傳統方法提升了一個數量級以上,且性能更優。」董超介紹,HYPIR主要有兩個創新點,一是使用預訓練擴散模型初始化復原網絡;二是從理論角度出發解釋這一簡單方法背後蘊含的深刻原理。

實驗數據顯示,在單張顯卡(圖像處理器)上,HYPIR僅需1.7秒即可完成一張1024x1024分辨率圖像的復原。相比現有的圖像復原方法,研究人員提出的HYPIR在復原圖像的質量上性能更優,且能夠適用於各種尺寸的預訓練擴散模型,為不同應用場景提供了靈活性。

在應用層面,研究人員介紹,HYPIR在圖像高清分辨率、文字保真、理解能力、用戶控制靈活性等方面均展現出了優異的性能。

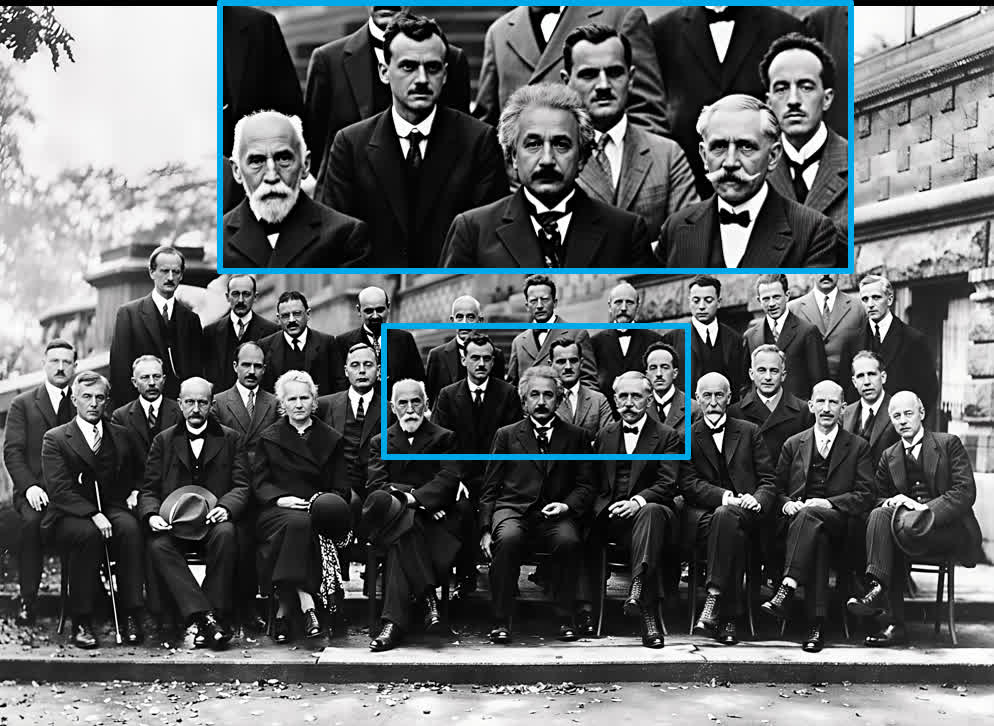

例如,在老照片修復方面,研究人員運用HYPIR修復了國內外經典電影、電視劇老照片,讓模糊的影像重現清晰的細節,為文化記憶傳承提供了技術支持。在高分辨率圖像修復領域,因其兼具速度與效果,HYPIR成功攻克了傳統方法在生成8k分辨率圖像時往往面臨速度慢或效果不佳的難題。

在文字保真方面,HYPIR能夠使復原出的文字保持高保真度和清晰度,無論是簡單的標識還是複雜的文檔,HYPIR都能精準地還原其原始形態,使圖像中的文字清晰可讀。

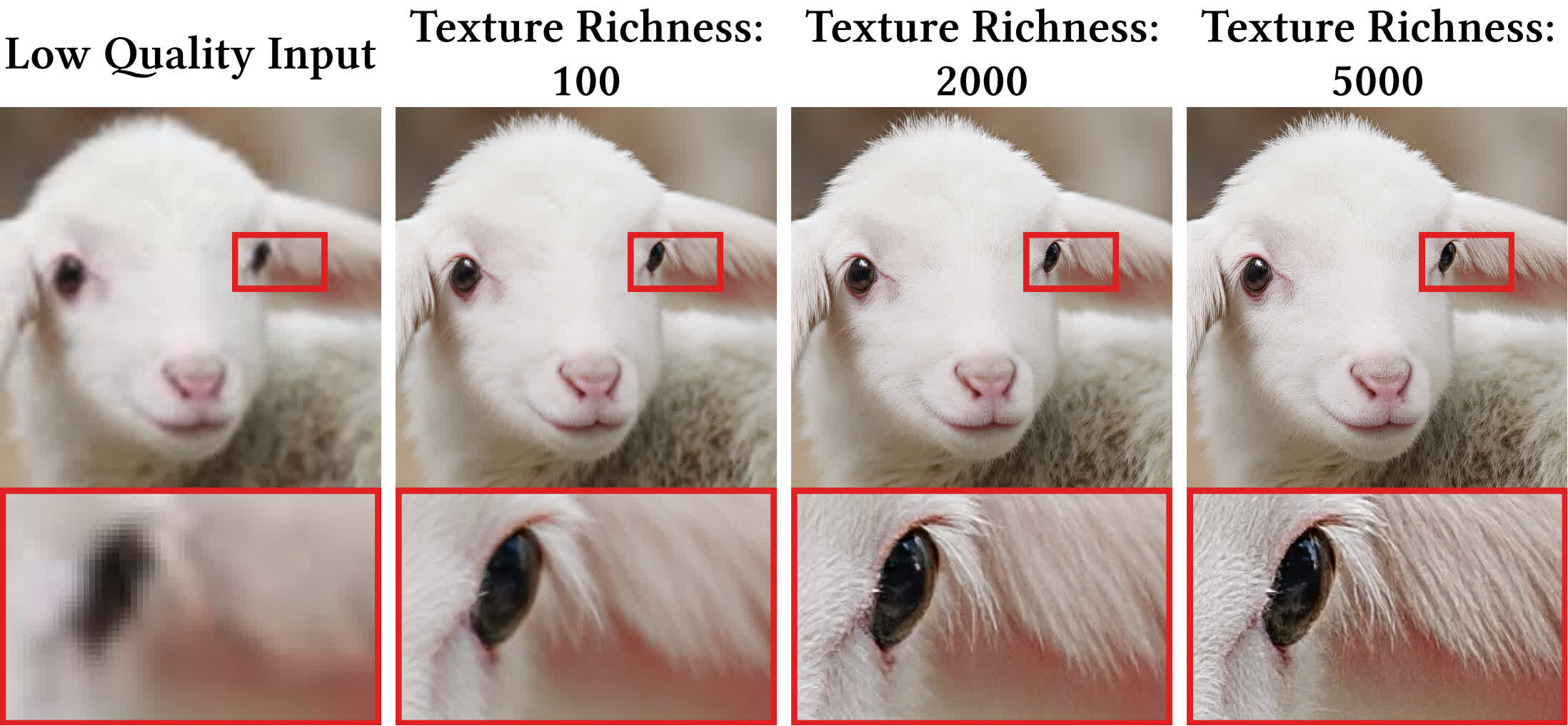

HYPIR還具備了突出的自然語言理解能力,能夠精準捕捉和理解用戶的輸入指令,在圖像復原過程中準確地反映用戶的意圖。此外,用戶可以根據需求靈活調節生成與復原的平衡,或精細控制圖像細節程度,從而獲得符合自身偏好的結果。

目前HYPIR大模型的開源代碼和模型已上傳至GitHub開放使用並已成功部署於明犀科技平台中,同時與深圳市南山區檔案館合作對部分館藏照片進行修復,後續該大模型還將進一步推進產業化,讓社會公眾親身體驗科技魅力。

評論