國安教育增四領域 涵人工智能數據安全

教育界:有助學生及早裝備應對社會未來挑戰

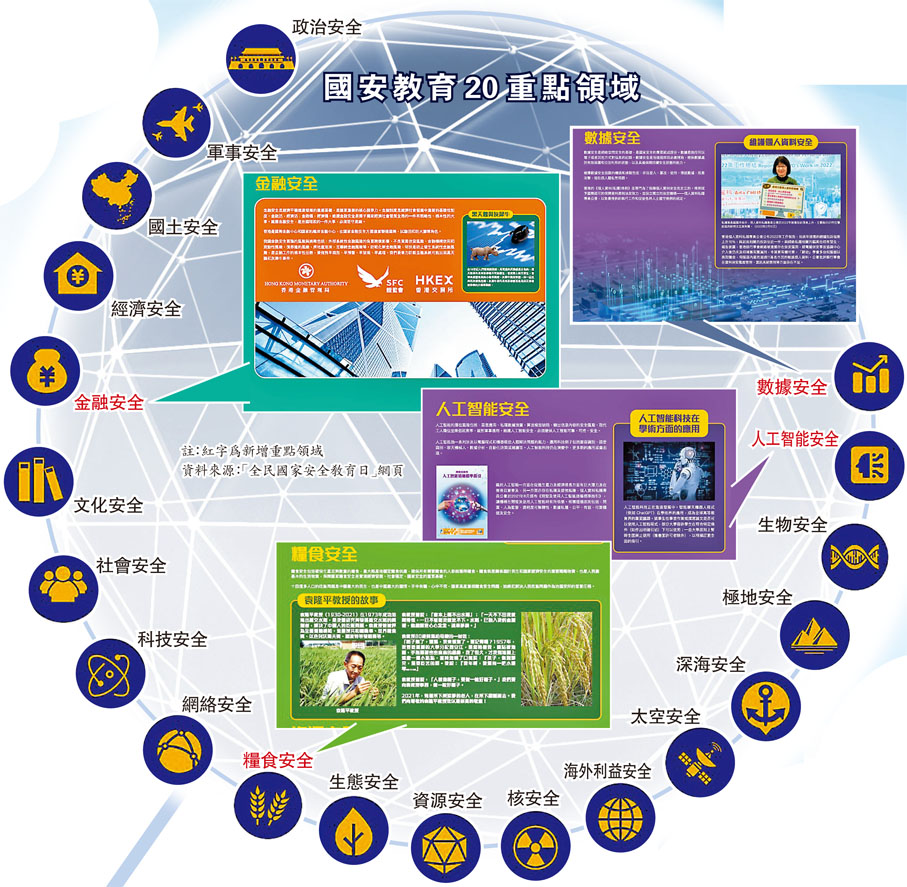

隨着國家及國際社會形勢不斷發展,為讓香港市民更具體了解國家安全所涉的方方面面,國安教育的涵蓋內容亦持續更新。香港特區政府「全民國家安全教育日」網頁最新資料顯示,國家安全的重點領域近日進行了更新,由原有的16個增至20個。新增的4個重點領域分別為人工智能安全、數據安全、金融安全和糧食安全。其中,人工智能安全、數據安全均羅列出相關領域發展的挑戰與機遇,包括人工智能具備模仿人類解決問題的巨大潛力,亦面臨遭受惡意應用、私隱數據洩露、取代工人職位等潛在風險。最近引起全球熱議的智能聊天機械人ChatGPT,亦有作為例子於今次更新中提及。教育界人士認為,是次更新與時並進,有助學生及早裝備自己,應對社會未來挑戰。◆香港文匯報記者 陸雅楠

總體國家安全突破傳統安全領域,即政治安全、國土安全和軍事安全,將國家安全的概念擴闊至其他重點領域。為應付新時代的挑戰及需要,國家安全重點領域亦會適時作出更新,以便全方位覆蓋不同層面,保障國家核心利益及人民安全。

指AI存在私隱道德風險

特區政府「全民國家安全教育日」網頁是次更新的4個領域分別為人工智能安全、數據安全、金融安全和糧食安全。人工智能安全方面,專文介紹了人工智能的定義,指的是一系列涉及以電腦程式和機器模仿人類解決問題的能力,應用例子包括面容識別、語音識別、數據分析、自動化決策或建議等。

專文指出,人工智能一方面在促進生產力及經濟增長方面有巨大潛力,也在香港日漸普及,另一方面亦存在私隱及道德風險。當中的潛在風險就包括惡意應用、私隱數據洩露、輸出信息內容的安全風險、取代工人職位並降低就業率、敵對軍事應用等。因此要維護人工智能安全,確保人工智能可靠、可控。

例如,個人資料私隱專員公署於2021年8月頒布《開發及使用人工智能道德標準指引》,讓機構在開發及使用人工智能時有所依循,相關道德原則包括問責、人為監督、透明度可解釋性、數據私隱、公平、有益、可靠穩健及安全。

不過,在當今科技日新月異的情況下,法規、指引始終難以追上人工智能科技的急速發展。以ChatGPT在學術界的應用為例,部分大學容許學生在特定條件,如作出明確引述的前提下,使用人工智能程式幫助完成作業或撰寫論文,亦有大學原則上暫時全面禁止使用,以待擬訂更全面的指引。

數據或被非法登入篡改

數據安全領域方面,專文介紹數據是指任何以電子或其他方式對信息的紀錄,而數據安全是指通過採取必要措施,確保數據處於有效保護和合法利用的狀態,以及具備保障持續安全狀態的能力。維護數據安全面臨的機遇和挑戰包括非法登入、篡改、使用、傳送數據惡意攻擊,侵犯個人隱私等問題。

專文提到,香港的《個人資料(私隱)條例)》是專門為了保障個人資料安全而定立,並設有獨立法定機構——個人資料私隱專員公署,以負責條例的執行工作及促使各界人士遵守條例的規定。該署2022年工作報告指該年接獲的總體投訴個案上升15%,與起底相關投訴佔近一半,而跟網絡私隱相關的騙案亦時有發生,提醒公眾應時刻注意維護個人資料安全。